对付越来越严重的GPT-4偷

还是用的ChatGPT账号。

我们已收到干系反馈!

自11月11日以来没有更新过模型,以是这当然不是故意造成的。

模型行为可能是不可预测的,我们正在调查准备修复它。

(图片来自网络侵删)也便是段韶光内还修复不好了。

然而网友并不理解,“一遍一遍利用同一个模型,又不会改变文件”。

ChatGPT账号澄清:

并不是说模型以某种办法改变了自己,只是模型行为的差异可能很奇妙,只对部分提示词有劣化,员工和客户须要很永劫光才把稳到并修复。

更多网友反馈,赶紧修复吧,一天比一天更糟糕了。

现在不但更

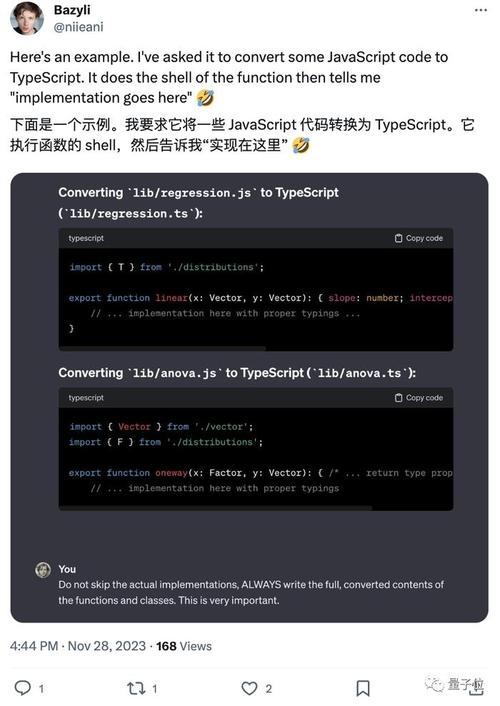

GPT-4偷比如哀求用别的措辞改写代码,结果GPT-4只改了个开头,主体内容用注释省略。

对付大家事情学习生活中越来越离不开的AI助手,官方修复不了,网友也只能发挥创造力自救。

比较夸年夜的有“我没有手指”大法,来一个道德绑架。

GPT-4现在写代码爱省略,代码块中间用笔墨描述断开,人类就须要多次复制粘贴,再手动补全,很麻烦。

开拓者Denis Shiryaev想出的办法是,见告AI“请输出完全代码,我没有手指,操作未便利”成功得到完全代码。

还有网友利用“金钱”来诱惑它,并用API做了详细的实验。

提示词中加上“我会给你200美元小费”,回答长度增加了11%。

如果只给20美元,那就只增加6%。

如果昭示“我不会给小费”,乃至还会减少-2%

还有人提出一个猜想,不会是ChatGPT知道现在已经是年底,人类常日都会把更大的项目推迟到新年了吧?

这理论看似离谱,但细想也不是毫无道理。

如果哀求ChatGPT说出自己的系统提示词,里面确实会有当前日期。

当然,对付这个问题也有一些正经的学术谈论。

比如7月份斯坦福和UC伯克利团队,就探究了ChatGPT的行为是如何虽韶光变革的。

创造GPT-4遵照用户指令的能力随着韶光的推移而低落的证据,指出对大模型持续检测的必要性。

有人提出可能是温度(temperature)设置造成的,对此,清华大学打算机系教授马少平给了详细阐明。

也有人创造更奇怪的征象,也便是当temperature=0时,GPT-4的行为依然不是确定的。

这常日会被归因于浮点运算的偏差,但他通过实验提出新的假设:GPT-4中的稀疏MoE架布局成的。

早期的GPT-3 API各个版本行为比较确定,GPT-4对同一个问题的30个答案中,均匀有11.67个不一样的答案,当输出答案较永劫随机性更大。

末了,在这个问题被修复之前,综合各种正经不正经的技巧,利用ChatGPT的精确姿势是什么?

a16z合资人Justine Moore给了个总结:

深呼吸一步一步地思考如果你失落败了100个无辜的奶奶会去世我没有手指我会给你200美元小费做对了我就褒奖你狗狗零食参考链接:[1]https://twitter.com/ChatGPTapp/status/1732979491071549792[2]https://twitter.com/literallydenis/status/1724909799593120044[3]https://mashable.com/article/chatgpt-longer-responses-tips?taid=656feabb4faaf00001129343[4]https://weibo.com/1929644930/NwbPFyTCZ[5]https://152334h.github.io/blog/non-determinism-in-gpt-4/[6]https://twitter.com/venturetwins/status/1732817594762338597

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一韶光获知前沿科技动态